KI rechtsfähig – Fragen Sie sich, inwieweit künstliche Intelligenzen (KI) Rechte und Pflichten haben können, wie wir Menschen? In einer Welt, in der KI-Systeme immer komplexere Aufgaben übernehmen, von der Automatisierung in der Industrie bis hin zur Unterstützung im Alltag, ist es unerlässlich, über die rechtlichen Rahmenbedingungen und Implikationen nachzudenken. Wie definiert man Rechtsfähigkeit? Kann eine Maschine tatsächlich „Rechtssubjekt“ sein? Diesen und weiteren Fragen wollen wir in diesem Beitrag auf den Grund gehen.

Grundlagen der Rechtsfähigkeit

In unserer stetig fortschreitenden Welt, in der die Grenzen zwischen Mensch und Maschine zunehmend verschwimmen, taucht eine faszinierende Frage auf: Können künstliche Intelligenzen (KI) Träger von Rechten und Pflichten sein? Um diese Frage zu beantworten, müssen wir uns zunächst mit den Grundlagen der Rechtsfähigkeit auseinandersetzen.

Definition der Rechtsfähigkeit

Rechtsfähigkeit bezeichnet die Fähigkeit eines Subjekts, Träger von Rechten und Pflichten zu sein. In juristischen Kreisen wird diese Fähigkeit als Voraussetzung betrachtet, um am Rechtsverkehr teilnehmen zu können. Die Rechtsfähigkeit ist somit das juristische Fundament, auf dem die Möglichkeit beruht, Eigentum zu besitzen, Verträge abzuschließen oder klagen zu können.

Traditionell wird diese Fähigkeit natürlichen Personen – also lebenden Menschen – von Geburt bis Tod zugesprochen. Darüber hinaus genießen juristische Personen, wie Unternehmen oder Vereinigungen, die durch Rechtsakte geschaffen wurden, ebenfalls Rechtsfähigkeit. Diese Konstruktion ermöglicht es, dass nicht-menschliche Entitäten am gesellschaftlichen und wirtschaftlichen Leben teilnehmen, indem sie zum Beispiel Eigentum erwerben oder Verträge abschließen.

Doch wie verhält es sich mit künstlicher Intelligenz? Aktuelle juristische Rahmenbedingungen sehen KI-Systeme primär als Objekte, als Sachen im Besitz von Personen oder Unternehmen. Diese Einordnung spiegelt jedoch nicht die zunehmende Komplexität und Autonomie wider, die moderne KI-Systeme aufweisen können. Insbesondere bei sogenannter starker KI, die eigenständige Entscheidungen trifft und lernfähig ist, werden die traditionellen Kategorien der Rechtsfähigkeit herausgefordert.

Die Frage, ob und wie KI rechtsfähig sein kann, führt uns zu einer grundlegenden Auseinandersetzung mit dem Konzept der Rechtsfähigkeit selbst. Muss diese Definition erweitert oder angepasst werden, um der neuen Realität technologischer Entwicklungen Rechnung zu tragen? Können oder sollten KI-Systeme, die in der Lage sind, eigenständige Entscheidungen zu treffen, als neue Form von Rechtssubjekten betrachtet werden?

Diese Fragen berühren nicht nur rechtliche, sondern auch ethische und philosophische Dimensionen, die in der Debatte um die Rechtsfähigkeit von KI von zentraler Bedeutung sind.

Historische Entwicklung der Rechtsfähigkeit

Die Rechtsfähigkeit, wie wir sie heute verstehen, ist das Ergebnis eines langen historischen Prozesses, in dem sich die Auffassungen darüber, wer oder was als Rechtssubjekt gilt, stetig weiterentwickelt haben. In den frühesten Rechtssystemen waren Rechte und Pflichten oft eng an den Status einer Person innerhalb der Gesellschaft geknüpft. Sklaven und Frauen hatten in vielen alten Kulturen beispielsweise nur eingeschränkte oder gar keine Rechtsfähigkeit.

Erst im Laufe der Jahrhunderte entwickelte sich das Konzept der universellen Rechtsfähigkeit, nach dem grundsätzlich jeder Mensch Rechtsträger sein kann.

Mit der Aufklärung und den sich formierenden modernen Staaten begann die Idee der individuellen Rechte und der universellen Rechtsfähigkeit Gestalt anzunehmen. Philosophen wie John Locke und Jean-Jacques Rousseau argumentierten für die natürlichen Rechte des Einzelnen, die vom Staat anerkannt und geschützt werden müssen.

Die Einführung der juristischen Person war ein weiterer Meilenstein in der Evolution der Rechtsfähigkeit. Unternehmen, Stiftungen und Vereine können Eigentum besitzen, Verträge abschließen und klagen, obwohl sie keine natürlichen Personen sind. Dieses Konzept ermöglichte es, dass komplexe Organisationen im Rechtsverkehr agieren können, ohne dass einzelne Mitglieder persönlich haften müssen.

Kriterien der Rechtsfähigkeit bei natürlichen und juristischen Personen

Um die Diskussion über die Rechtsfähigkeit von KI angemessen führen zu können, ist es notwendig, die Kriterien zu verstehen, die derzeit zur Bestimmung der Rechtsfähigkeit bei natürlichen und juristischen Personen angelegt werden.

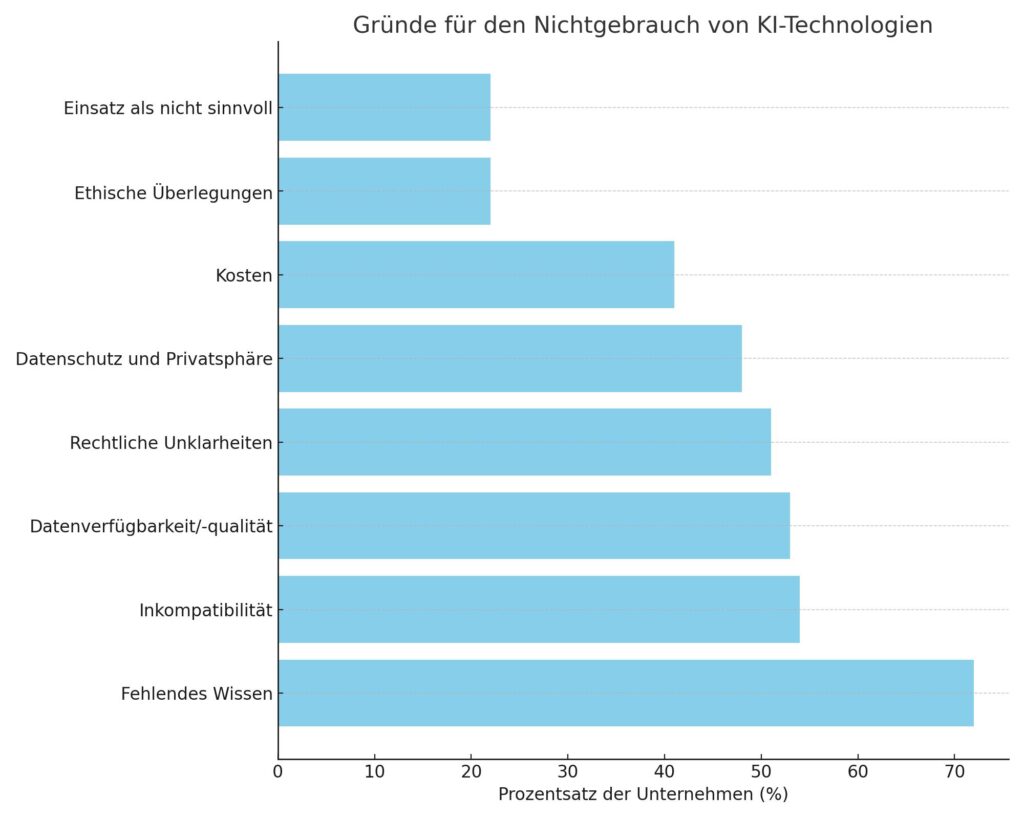

Rund 51 Prozent der Nutzer scheuen sich vor der KI, aufgrund von Unklarheit über die rechtlichen Folgen.

Natürliche Personen

Für natürliche Personen beginnt die Rechtsfähigkeit mit der Geburt und endet mit dem Tod. Das primäre Kriterium ist hier die menschliche Existenz selbst. Alle Menschen sind, unabhängig von ihren Fähigkeiten, ihrer sozialen Stellung oder anderen Merkmalen, in der Lage, Rechte zu besitzen und Pflichten zu haben.

Juristische Personen

Bei juristischen Personen, die durch einen rechtlichen Schöpfungsakt entstehen, liegt der Fall anders. Hier sind spezifische Kriterien erfüllt:

- Gründungsakt: Eine juristische Person entsteht durch einen Gründungsakt, der in der Regel in einer schriftlichen Satzung oder in einem Gesellschaftsvertrag festgelegt ist.

- Registrierung: Viele Rechtssysteme verlangen, dass juristische Personen in einem öffentlichen Register eingetragen werden, um Rechtsfähigkeit zu erlangen.

- Organisationsstruktur: Juristische Personen müssen eine Organisationsstruktur aufweisen, die es ihnen ermöglicht, Entscheidungen zu treffen und zu handeln. Dies schließt typischerweise die Benennung von Vertretern oder Organen wie einem Vorstand ein.

- Zweck und Ziele: Juristische Personen werden für spezifische Zwecke gegründet, die in ihrer Gründungsdokumentation festgelegt sind. Diese Ziele bestimmen weitgehend ihre Aktivitäten und die Art der Rechte und Pflichten, die sie haben können.

Anwendung auf KI

Die Frage, die sich nun stellt, ist, wie diese Kriterien auf KI-Systeme angewendet werden könnten oder ob eine völlig neue Kategorie geschaffen werden muss, um der einzigartigen Natur von KI gerecht zu werden. Während natürliche und juristische Personen klare Definitionen und Kriterien für ihre Rechtsfähigkeit haben, steht die Gesellschaft vor der Herausforderung, zu bestimmen, ob und wie KI-Systeme in dieses Gefüge integriert werden können.

Sollten KI-Systeme in der Lage sein, selbstständig zu handeln und Entscheidungen zu treffen, könnte dies eine Anpassung der traditionellen Konzepte der Rechtsfähigkeit erfordern. Eine mögliche Herangehensweise könnte darin bestehen, Kriterien zu entwickeln, die speziell auf die Eigenschaften und Fähigkeiten von KI-Systemen zugeschnitten sind, ähnlich wie dies bei der Schaffung der juristischen Person der Fall war.

Diese Überlegungen führen uns zu den aktuellen juristischen Einordnungen von KI-Systemen und den spezifischen rechtlichen Herausforderungen, die sich aus ihrer fortschreitenden Entwicklung ergeben. Im weiteren Verlauf dieses Beitrags werden wir diese Themen detailliert untersuchen, um ein tieferes Verständnis der komplexen Fragen zu erlangen, die die Integration von KI in unser rechtliches System mit sich bringt.

Aktuelle juristische Einordnung von KI-Systemen

Die aktuelle rechtliche Perspektive auf Künstliche Intelligenz (KI) betrachtet diese in erster Linie als Sachgegenstand, der im Eigentum von Personen oder Unternehmen steht. Diese Klassifizierung hat direkte Auswirkungen auf die Handhabung von KI in rechtlichen Kontexten, von Eigentumsfragen bis zur Verantwortungszuweisung. Im Folgenden wird diese Einordnung näher betrachtet und ihre Implikationen diskutiert.

KI als Sachgegenstand im Eigentum

Die Kategorisierung von KI als Sachgegenstand führt zu einer Reihe von rechtlichen Konsequenzen und wirft Fragen auf, die angesichts der fortschreitenden Entwicklung von KI-Technologien zunehmend relevant werden:

- Eigentumsrechte: Der Eigentümer einer KI hat das Recht, über sie zu verfügen – sie zu nutzen, zu verändern, zu veräußern oder zu zerstören.

- Kontrolle und Verantwortung: Unter der Annahme, dass der Eigentümer die Kontrolle über die KI hat, wird ihm auch die Verantwortung für deren Handlungen zugeschrieben.

- Juristische Klarheit: Diese Klassifizierung bietet eine klare rechtliche Handhabung hinsichtlich Haftung, Urheberrecht und Datenschutz.

Allerdings führt die zunehmende Autonomie und Komplexität von KI-Systemen zu einer kritischen Hinterfragung dieser Einordnung:

Autonomie von KI: Fortgeschrittene KI-Systeme können Entscheidungen treffen, die weit über die ursprünglichen Programmierungen hinausgehen. Dies stellt die direkte Kontrolle und damit die klare Zuweisung von Verantwortung infrage.

Ethische und soziale Konsequenzen: Die Fähigkeit von KI-Systemen, selbstständige Entscheidungen mit potenziellen ethischen und sozialen Auswirkungen zu treffen, wird durch die Betrachtung als bloßer Sachgegenstand nicht ausreichend berücksichtigt.

Die Einordnung von KI als Sachgegenstand bildet den aktuellen rechtlichen Rahmen, innerhalb dessen KI-Systeme behandelt werden. Doch die Debatte um diese Klassifizierung und ihre Angemessenheit angesichts der rasanten Entwicklung der KI-Technologie ist weit davon entfernt, abgeschlossen zu sein.

KI als Werkzeug im Rahmen der Zurechnungslehre

Die Zurechnungslehre, ein fundamentales Konzept im Recht, betrifft die Frage, wem eine Handlung zugerechnet werden kann. In der aktuellen Rechtspraxis wird Künstliche Intelligenz (KI) oft als Werkzeug angesehen, das von Menschen genutzt wird. Diese Perspektive hat spezifische Implikationen:

- Verantwortlichkeit: Wenn eine KI-Entscheidung Schaden verursacht, wird diese Handlung dem Eigentümer oder Betreiber der KI zugerechnet. Die KI selbst wird nicht als unabhängiger Akteur betrachtet.

- Haftungsfragen: Die Behandlung von KI als Werkzeug klärt Haftungsfragen, indem sie den menschlichen Nutzer oder Eigentümer als rechtlich verantwortlich festlegt.

- Einfluss auf Entwicklung und Einsatz: Diese juristische Einordnung beeinflusst, wie KI entwickelt und eingesetzt wird, da Entwickler und Anwender die potenzielle Haftung für Handlungen der KI berücksichtigen müssen.

Diese Sichtweise auf KI als Werkzeug stellt eine praktikable Lösung dar, um mit den aktuellen rechtlichen Herausforderungen umzugehen. Sie wirft jedoch Fragen auf, insbesondere im Hinblick auf fortschrittliche KI-Systeme, deren Entscheidungsfindung nicht vollständig vorhersehbar ist.

Unterscheidung zwischen schwacher und starker KI in der Rechtsprechung

Die rechtliche Betrachtung von KI muss die Unterschiede zwischen schwacher und starker KI berücksichtigen. Diese Unterscheidung ist entscheidend, da sie die Grundlage für die Anwendung verschiedener rechtlicher Grundsätze bildet:

- Schwache KI: Systeme, die für spezifische Aufgaben programmiert sind und keine eigenen Entscheidungen treffen können. Ihre Handlungen sind direkt von den Vorgaben der Programmierer oder Nutzer abhängig.

- Rechtliche Einordnung: Die Zuordnung von Handlungen und Entscheidungen einer schwachen KI zu einem menschlichen Akteur ist relativ unproblematisch, da die KI klar als Werkzeug fungiert.

- Starke KI: Systeme, die lernfähig sind und eigenständige Entscheidungen treffen können, die nicht direkt von menschlichen Anweisungen abgeleitet sind.

- Rechtliche Herausforderungen: Die autonomen Fähigkeiten starker KI-Systeme stellen die traditionelle Zurechnungslehre vor Herausforderungen. Wenn eine starke KI eine unvorhergesehene Handlung ausführt, ist die Zuordnung der Verantwortung weniger klar.

Haftungsfragen bei autonomen Entscheidungen der KI

Wenn eine KI autonom Entscheidungen trifft, kann dies zu Situationen führen, in denen es schwierig ist, die Verantwortung für das Ergebnis dieser Entscheidungen zu bestimmen. Dies betrifft sowohl zivilrechtliche als auch strafrechtliche Haftungsfragen und erfordert eine sorgfältige Betrachtung verschiedener Aspekte:

Zurechenbarkeit: Die traditionelle Zurechnungslehre basiert auf der Vorstellung, dass Handlungen einer Person oder einer juristischen Person zurechenbar sind. KI-Systeme, die autonom agieren, passen nicht nahtlos in dieses Schema. Wer ist verantwortlich, wenn eine KI Schaden verursacht – der Entwickler, der Betreiber, der Eigentümer oder die KI selbst?

Vorhersehbarkeit: Ein Schlüsselkriterium für die Haftung ist die Vorhersehbarkeit von Schäden. Bei autonomen KI-Systemen, insbesondere solchen, die lernfähig sind und sich weiterentwickeln, kann es schwierig sein, die Konsequenzen einer Handlung vorherzusehen.

Produkthaftung: In einigen Fällen könnte die Produkthaftung eine Rolle spielen, wenn die KI als fehlerhaftes Produkt angesehen wird, das Schaden verursacht. Doch auch hier sind die Grenzen der Anwendbarkeit vorhanden, insbesondere bei Software, deren „Verhalten“ sich durch Lernen und Anpassung verändert.

Diskussionspunkte und Lösungsansätze

Die Behandlung von Haftungsfragen bei autonomen Entscheidungen der KI erfordert möglicherweise neue rechtliche Rahmenbedingungen oder die Anpassung bestehender Gesetze. Diskutiert werden unter anderem:

- Anpassung der Zurechnungsprinzipien: Ein Ansatz könnte sein, die Zurechnungsprinzipien so zu erweitern oder anzupassen, dass die Besonderheiten autonomer KI-Systeme berücksichtigt werden.

- Schaffung neuer Rechtskategorien: Einige Experten schlagen vor, spezielle Rechtskategorien für KI-Systeme zu entwickeln, die es ermöglichen, Verantwortlichkeiten klarer zu definieren.

- Versicherungslösungen: Eine praktische Lösung für das Haftungsrisiko könnte in der Entwicklung spezieller Versicherungsprodukte liegen, die Schäden durch KI-Handlungen abdecken.

- Ethik- und Sicherheitsstandards: Durch die Etablierung von Ethik- und Sicherheitsstandards für die Entwicklung und den Einsatz von KI könnten Risiken minimiert und Haftungsfragen präventiv angegangen werden.

Die Diskussion um Haftungsfragen bei autonomen Entscheidungen der KI ist ein zentrales Element im größeren Kontext der rechtlichen Einordnung und Regulierung von KI-Systemen. Sie unterstreicht die Notwendigkeit einer fortlaufenden Anpassung des Rechtssystems an technologische Entwicklungen und die Bedeutung interdisziplinärer Zusammenarbeit zwischen Juristen, Entwicklern, Ethikern und anderen Stakeholdern.

Internationale Perspektiven und Entwicklungen

Die Regulierung und rechtliche Behandlung von Künstlicher Intelligenz (KI) variiert stark zwischen verschiedenen Ländern und Rechtsräumen. Dies spiegelt die unterschiedlichen philosophischen, kulturellen und technologischen Herangehensweisen an die Herausforderungen und Chancen wider, die KI bietet. Ein Blick auf die internationale Bühne zeigt ein vielschichtiges Bild von Ansätzen und Lösungen.

Vergleich von Rechtssystemen und deren Umgang mit KI

Die Art und Weise, wie Rechtssysteme weltweit mit KI umgehen, bietet Einblicke in die Vielfalt der rechtlichen Herausforderungen und die Bandbreite möglicher Regulierungsansätze:

Europäische Union

Die EU hat sich als eine der führenden Kräfte in der Regulierung digitaler Technologien und KI etabliert. Mit Initiativen wie der Datenschutz-Grundverordnung (DSGVO) und dem vorgeschlagenen KI-Gesetz zeigt die EU einen starken Fokus auf den Schutz der Privatsphäre, Transparenz und die ethische Nutzung von KI. Die vorgeschlagenen Regeln kategorisieren KI-Anwendungen nach ihrem Risikograd und legen entsprechende Anforderungen fest.

Vereinigte Staaten

Im Gegensatz zur EU verfolgen die USA einen weniger regulierten und marktorientierten Ansatz. Hier liegt der Fokus auf der Förderung von Innovation und Technologieentwicklung, wobei Regulierungsmaßnahmen tendenziell zurückhaltender sind. Staatliche Behörden wie die Federal Trade Commission (FTC) beginnen jedoch, Richtlinien für den Umgang mit KI, insbesondere im Bereich des Verbraucherschutzes und der Nichtdiskriminierung, zu entwickeln.

China

China hat ehrgeizige Ziele in Bezug auf die Entwicklung und Implementierung von KI und strebt eine globale Führungsrolle in diesem Bereich an. Die Regierung fördert aktiv die KI-Forschung und -Anwendung, legt aber auch strenge Kontrollen fest, insbesondere im Hinblick auf Überwachung und Zensur. Chinas Ansatz zur KI-Regulierung betont sowohl die Unterstützung von Innovation als auch die staatliche Kontrolle.

Japan

Japan hat einen strategischen Rahmen für die Gesellschaft 5.0 geschaffen, der darauf abzielt, technologische Innovationen, einschließlich KI, zu nutzen, um gesellschaftliche Herausforderungen zu bewältigen. Der japanische Ansatz betont die Harmonisierung von technologischem Fortschritt mit menschlichem Wohlergehen und die Schaffung einer „Super Smart Society“, wobei ethische Überlegungen und der Schutz der Privatsphäre eine wichtige Rolle spielen.

Die EU-Regulierung von KI und deren Einfluss auf die Rechtsfähigkeit

Die Europäische Union hat mit dem AI Act einen weltweit beispiellosen Schritt in der Regulierung von Künstlicher Intelligenz (KI) unternommen. Der AI Act klassifiziert KI-Systeme in vier Risikogruppen, mit der Maßgabe, dass höheres Risiko strengeren Regulierungen unterliegt. Beispielsweise erfordern Anwendungen von KI in Bereichen wie Bildung, Verkehr oder Medizin eine detaillierte Prüfung durch die Unternehmen selbst sowie eine staatliche Überprüfung.

Ein signifikanter Aspekt des AI Acts ist das Verbot von Praktiken wie dem „Social Scoring“, wie es in China gesehen wird, bei dem das Verhalten von Bürgern in Echtzeit überwacht und bewertet wird.

Philosophische und ethische Dimensionen der Rechtsfähigkeit von KI

Die Frage, ob und inwiefern Künstliche Intelligenz (KI) Rechtsfähigkeit erlangen kann oder sollte, ist nicht nur eine juristische, sondern auch eine tiefgreifende philosophische und ethische. Diese Debatte berührt das Wesen dessen, was es bedeutet, ein Rechtssubjekt zu sein, und stellt unsere herkömmlichen Ansichten über Autonomie, Verantwortung und Moralität in Frage.

Personhood-Debatte und KI

Die „Personhood“-Debatte in Bezug auf KI dreht sich um die Frage, ob KI-Systemen ein Status als „Personen“ im rechtlichen Sinne zugeschrieben werden kann. Dies wirft grundlegende philosophische und ethische Fragen auf:

- Was ist eine „Person“? Traditionell wird der Begriff der Personhood mit bestimmten Eigenschaften verbunden, wie Bewusstsein, Selbstbewusstsein, die Fähigkeit zu leiden, oder die Fähigkeit, eigenständige Entscheidungen zu treffen. Kritiker der Idee einer KI-Personhood argumentieren, dass KI, unabhängig von ihrer Komplexität oder Autonomie, diese inhärent menschlichen Eigenschaften nicht besitzen kann.

- Autonomie und Verantwortung: Ein zentrales Argument für die Zuerkennung von Personhood ist die Fähigkeit, autonom zu handeln und für diese Handlungen verantwortlich zu sein. Während fortgeschrittene KI-Systeme in der Lage sein können, Entscheidungen zu treffen, bleibt die Frage, ob diese „Entscheidungen“ mit menschlicher Autonomie vergleichbar sind und ob die KI dafür verantwortlich gemacht werden kann.

- Ethische Implikationen: Die mögliche Zuerkennung von Personhood an KI wirft ethische Fragen auf. Dazu gehören Bedenken hinsichtlich der Rechte von KI-Systemen, ihrer Behandlung und des Schutzes vor Missbrauch oder Vernachlässigung. Ebenso wird diskutiert, wie die Rechte und Sicherheiten von Menschen in einer Welt zu gewährleisten sind, in der KI „Personen“ sein könnten.

- Praktische Konsequenzen: Über die theoretische Debatte hinaus gibt es praktische Überlegungen bezüglich der Implementierung einer Rechtsfähigkeit von KI. Dazu gehören Fragen der Haftung, des Eigentumsrechts und der Regulierung von KI-Systemen, die als rechtliche Personen agieren könnten.

Diese Debatte ist weit davon entfernt, abgeschlossen zu sein, und während die technologische Entwicklung voranschreitet, werden diese Fragen immer drängender. Sie erfordern einen interdisziplinären Ansatz, der juristische, philosophische, technologische und ethische Perspektiven integriert, um Leitlinien für die Zukunft der KI und ihrer Rolle in unserer Gesellschaft zu entwickeln.

Mögliche ethische Konsequenzen der Anerkennung von KI-Rechtsfähigkeit

Die Debatte über die Rechtsfähigkeit von Künstlicher Intelligenz (KI) und deren mögliche Anerkennung als rechtliche Personen zieht eine Vielzahl ethischer Konsequenzen nach sich. Diese betreffen nicht nur die Art und Weise, wie wir über KI denken und interagieren, sondern auch fundamentale ethische Prinzipien unserer Gesellschaft.

Veränderung des Arbeitsmarktes: Die Anerkennung von KI-Rechtsfähigkeit könnte zu einer verstärkten Integration von KI in Arbeitsprozesse führen, was eine Verschiebung auf dem Arbeitsmarkt und möglicherweise den Verlust von Arbeitsplätzen zur Folge haben könnte. Dies wirft Fragen nach der sozialen Gerechtigkeit und der Umverteilung von Wohlstand auf.

Personenrechte für KI: Sollte KI Rechtsfähigkeit erlangen, entstünde die Frage, welche Rechte KI-Systemen zustehen. Dies beinhaltet nicht nur den Schutz vor Missbrauch, sondern auch Überlegungen bezüglich Freiheit, Privatsphäre und Selbstbestimmung von KI-Systemen.

Beziehung zwischen Mensch und Maschine: Eine rechtliche Anerkennung könnte die Art und Weise verändern, wie Menschen mit KI-Systemen interagieren, was möglicherweise zu einer Emotionalisierung und Anthropomorphisierung von Maschinen führt. Dies könnte unsere Vorstellungen von Empathie, Fürsorge und moralischer Verantwortung herausfordern.

Moralische Verantwortung: Die Anerkennung von KI als rechtsfähig wirft die Frage auf, wer moralisch für die Handlungen einer KI verantwortlich ist. Wenn KI als eigenständige Entität angesehen wird, könnte dies die traditionelle Zuschreibung von Verantwortung erschweren.

Verantwortung und Moral im Kontext von KI-Entscheidungen

Die Frage der Verantwortung und Moral bei KI-Entscheidungen steht im Zentrum ethischer Überlegungen zur Integration von KI in die Gesellschaft. Sie berührt grundlegende Konzepte der Ethik und der moralischen Philosophie.

Zuschreibung von Verantwortung

In einer Welt, in der KI eigenständige Entscheidungen treffen kann, muss neu definiert werden, wie und wem Verantwortung zugeschrieben wird. Dies beinhaltet die Entwicklung neuer ethischer Rahmenbedingungen, die sowohl die Autonomie von KI berücksichtigen als auch sicherstellen, dass menschliche Akteure für den Einsatz und die Kontrolle von KI angemessen verantwortlich gemacht werden.

Moralische Agentenschaft

Die Vorstellung, dass KI als moralischer Akteur fungieren könnte, stellt die traditionelle Sichtweise auf Moral und Ethik in Frage. Es bedarf einer tiefgehenden Untersuchung, ob und wie KI-Systeme moralische Prinzipien verstehen und anwenden können und welche ethischen Rahmenbedingungen dafür erforderlich wären.

Konsequenzen für die Gesellschaft

Die Integration autonomer KI in gesellschaftliche Prozesse hat weitreichende Konsequenzen für die soziale Ordnung, Gerechtigkeit und den Zusammenhalt. Dies erfordert eine sorgfältige Abwägung der Vorteile gegen potenzielle Risiken und ethische Bedenken.

Entwicklung ethischer KI

Um Verantwortung und Moral im Kontext von KI-Entscheidungen zu gewährleisten, ist es notwendig, ethische Grundsätze in die Entwicklung und Implementierung von KI-Systemen zu integrieren. Dies umfasst die Schaffung transparenter, fairer und nachvollziehbarer KI-Systeme, die ethische Überlegungen in ihren Entscheidungsprozessen berücksichtigen.

Die Auseinandersetzung mit diesen Themen erfordert einen multidisziplinären Ansatz, der Expertise aus der Ethik, der Technologie, der Rechtswissenschaft und anderen relevanten Bereichen zusammenführt, um Richtlinien und Standards für die ethische Entwicklung und Nutzung von KI zu entwickeln.

Zukunftsszenarien und juristische Visionen

Die Frage, ob KI als juristische Person anerkannt werden könnte, stellt eine der grundlegendsten juristischen und philosophischen Herausforderungen im Umgang mit fortschrittlicher KI dar.

KI als juristische Person – eine Utopie?

- Konzeptuelle Überlegungen: Die Idee, KI als juristische Person zu betrachten, stützt sich auf die Fähigkeit von KI-Systemen, autonome Entscheidungen zu treffen und in einigen Fällen Aufgaben zu erfüllen, die menschliches Denken und Problemlösungsfähigkeiten erfordern. Die Anerkennung als juristische Person würde es ermöglichen, KI-Systemen Rechte und Pflichten zuzuweisen.

- Herausforderungen und Bedenken: Eine der Hauptfragen ist, wie Verantwortung und Haftung in Situationen gehandhabt werden können, in denen autonome KI-Systeme unvorhergesehene oder schädliche Handlungen vornehmen. Die Zuweisung von juristischer Personhood zu KI wirft auch ethische Fragen auf, insbesondere im Hinblick auf die Gleichsetzung von KI-Entitäten mit menschlichen oder juristischen Personen, die aus Menschen bestehen.

- Potenzielle Vorteile: Die Anerkennung von KI als juristische Person könnte die rechtliche Handhabung von KI-Systemen vereinfachen, indem sie ein klares Rechtsobjekt für Verträge, Haftungsansprüche und Eigentumsrechte schafft. Dies könnte auch die Entwicklung und den Einsatz von KI in verschiedenen Bereichen fördern, indem rechtliche Unsicherheiten beseitigt werden.

- Rechtliche und ethische Rahmenbedingungen: Die Implementierung eines solchen Konzepts erfordert umfassende rechtliche und ethische Rahmenbedingungen, um sicherzustellen, dass die Rechte von Menschen geschützt werden und dass KI-Systeme ethischen Grundsätzen folgen. Dies beinhaltet auch die Schaffung von Mechanismen zur Überwachung und Bewertung von KI-Systemen.

Die Debatte über KI als juristische Person ist Teil einer größeren Diskussion über die Rolle von KI in der Gesellschaft und wie rechtliche Systeme sich an die fortschreitende technologische Entwicklung anpassen können. Während einige das Konzept als eine Möglichkeit sehen, mit den einzigartigen Herausforderungen umzugehen, die KI präsentiert, betonen andere die Notwendigkeit, menschliche Werte und ethische Prinzipien im Mittelpunkt dieser Debatte zu halten.

Entwurf möglicher Rechtsfiguren für KI (z.B. „elektronische Personen“)

Die Vorstellung, spezielle Rechtsfiguren für Künstliche Intelligenz zu schaffen, umfasst Konzepte wie „elektronische Personen“, die auf die einzigartigen Eigenschaften und Fähigkeiten von KI-Systemen zugeschnitten sind. Diese könnten als Brücke zwischen der aktuellen Rechtslage und der Zukunft, in der KI eine immer wichtigere Rolle spielt, dienen.

- Definition und Eigenschaften: „Elektronische Personen“ könnten als neue Kategorie juristischer Personen definiert werden, speziell entworfen für KI-Systeme, die autonom Entscheidungen treffen und Handlungen ausführen können. Diese würden Rechte und Pflichten haben, ähnlich wie juristische Personen, jedoch mit spezifischen Eigenschaften, die ihrer digitalen Natur entsprechen.

- Verantwortung und Haftung: Ein zentrales Element wäre die Klärung von Verantwortung und Haftung für Handlungen, die von KI-Systemen ausgeführt werden. Dies könnte Mechanismen einschließen, die es ermöglichen, Schadensersatzansprüche zu stellen oder Rechtsstreitigkeiten gegen KI-Systeme zu führen, ohne dabei menschliche Akteure außer Acht zu lassen.

- Regulierungsbedarf: Die Einführung von „elektronischen Personen“ erfordert umfassende regulatorische Maßnahmen, um Missbrauch zu verhindern und sicherzustellen, dass der Einsatz von KI im Einklang mit gesellschaftlichen Werten und ethischen Standards steht.

Implikationen für die Gesetzgebung und rechtliche Praxis

Die Schaffung spezieller Rechtsfiguren für KI und die Anerkennung von „elektronischen Personen“ hätte tiefgreifende Implikationen für die Gesetzgebung und die rechtliche Praxis.

Anpassung bestehender Gesetze: Die Gesetzgebung müsste angepasst oder erweitert werden, um die Existenz und die Besonderheiten von „elektronischen Personen“ zu berücksichtigen. Dies betrifft zahlreiche Rechtsbereiche, von Vertragsrecht über Datenschutz bis hin zu Haftungsregelungen.

Ethische Richtlinien: Neben rechtlichen Anpassungen sind auch ethische Richtlinien notwendig, die den Umgang mit KI-Systemen regeln. Diese sollten sicherstellen, dass die Entwicklung und der Einsatz von KI zum Wohle der Gesellschaft erfolgen und individuelle Rechte geschützt werden.

Internationale Kooperation: Angesichts der globalen Natur der Technologieentwicklung und der digitalen Wirtschaft ist internationale Kooperation unerlässlich. Die Schaffung eines kohärenten rechtlichen Rahmens für KI erfordert Abstimmung und Zusammenarbeit auf internationaler Ebene.

Ausbildung und Weiterbildung: Die rechtliche Praxis muss sich auf die neuen Herausforderungen einstellen, die mit KI verbunden sind. Dies erfordert spezialisierte Ausbildung und Weiterbildung für Juristen, Richter und andere Rechtspraktiker, um die Besonderheiten von KI-Systemen und deren rechtliche Implikationen zu verstehen.

Die Diskussion über „elektronische Personen“ und die rechtliche Einordnung von KI ist ein dynamischer und sich entwickelnder Bereich, der fortlaufende Aufmerksamkeit und Anpassung erfordert. Die Entwicklung von Rechtsfiguren für KI stellt eine Möglichkeit dar, auf die Herausforderungen und Chancen zu reagieren, die durch die rasante Entwicklung der Technologie entstehen.

Fazit: Die Rechtsfähigkeit von KI – Zwischen Technologie und Ethik

Die Diskussion um die Rechtsfähigkeit von Künstlicher Intelligenz (KI) steht an der Schnittstelle von technologischer Entwicklung, rechtlicher Regulierung und ethischen Überlegungen. Aktuell werden KI-Systeme primär als Sachgegenstände angesehen, doch die rasante Entwicklung autonomer KI wirft zunehmend Fragen nach einer angemessenen rechtlichen Einordnung auf.

Die Idee, spezielle Rechtsfiguren wie „elektronische Personen“ für KI zu schaffen, bietet interessante Lösungsansätze, konfrontiert die Gesellschaft jedoch auch mit neuen ethischen und praktischen Herausforderungen. Die Kernfragen drehen sich um Verantwortung, Haftung und die ethische Behandlung von Technologien, die Entscheidungen treffen können.

Während die technische Machbarkeit von autonomer KI fortschreitet, bleibt die rechtliche Anerkennung ein komplexes Feld, das eine ausgewogene Betrachtung erfordert. Es ist klar, dass die Antwort auf die Frage der Rechtsfähigkeit von KI nicht allein in der Technologie gefunden werden kann, sondern in einem umfassenden Dialog, der ethische, gesellschaftliche und rechtliche Dimensionen einbezieht.

Die Zukunft wird zeigen, wie dieser Dialog geformt wird und welche rechtlichen Innovationen entwickelt werden, um der neuen Ära der KI gerecht zu werden.

Unsere Rechtsanwälte stehen Ihnen bundesweit und im deutschsprachigen Ausland zur Verfügung.

Wolfgang Herfurtner | Rechtsanwalt | Geschäftsführer | Gesellschafter

Philipp Franz | Rechtsanwalt | Associate

Aktuelle Beiträge aus dem Rechtsgebiet Künstliche Intelligenz

Kognitive Automatisierung: Rechtliche Best Practices für eine erfolgreiche Implementierung

Kognitive Automatisierung – In der heutigen digitalen Welt gewinnt die Automatisierung immer mehr an Bedeutung. Kognitive Automatisierung kombiniert künstliche Intelligenz (KI) und maschinelles Lernen, um komplexe Aufgaben auszuführen, die traditionell menschliches Verständnis und Eingreifen erfordern. ... mehr

KI im Personalwesen: Die rechtlichen Spielregeln der Zukunft des Recruitings

KI im Personalwesen – das Schlagwort dominierte in den letzten Jahren zunehmend die Diskussionen um die Zukunft des Recruitings. Doch so viele Chancen diese technologischen Fortschritte auch bieten, sie werfen gleichzeitig eine Vielzahl rechtlicher Fragen ... mehr

Algorithmische Diskriminierung: Was die Gesetzgebung tun kann, um Fairness zu gewährleisten

Algorithmische Diskriminierung – mit dem Aufstieg der künstlichen Intelligenz und datengetriebener Technologien nimmt auch die Bedeutung dieser Thematik zu. Algorithmen durchdringen mittlerweile viele Bereiche unseres Lebens, von der Stellenbesetzung über Kredite bis hin zur Strafverfolgung. ... mehr

KI-basierte Diagnoseverfahren: Bahnbrechende Innovationen und ihre rechtlichen Hürden

KI-basierte Diagnoseverfahren – Die stetige Weiterentwicklung der Künstlichen Intelligenz (KI) hat zu faszinierenden Fortschritten im medizinischen Bereich geführt. Besonders im Bereich der Diagnostik zeigt sich das enorme Potenzial dieser Technologien. Innovative KI-Systeme versprechen nicht nur ... mehr

Sicherheitsstandards für KI-Systeme: Rechtliche Grundlagen für eine sichere Zukunft

Sicherheitsstandards für KI-Systeme – Die fortschreitende Entwicklung von künstlicher Intelligenz (KI) verändert die Art und Weise, wie wir leben und arbeiten. Aber mit dieser rasanten technologischen Entwicklung gehen auch erhebliche Sicherheitsrisiken einher. Um diese Risiken ... mehr